चिंताजनक है ‘डीपफेक पोर्नोग्राफी’ का चलन

punjabkesari.in Friday, Feb 13, 2026 - 05:00 AM (IST)

इस समय पोर्नोग्राफी के जरिए प्रभावशाली व्यक्तियों और महिलाओं को ब्लैकमेल करने की घटनाएं बड़ी तेजी से बढ़ रही हैं। यह आॢटफिशियल इंटैलीजैंस यानि कृत्रिम बुद्धिमता तकनीक का एक बड़ा दुरुपयोग है। यह हमारी सामाजिक चिंताओं में भी वृद्धि कर रहा है। डीपफेक पोर्नोग्राफी के इस्तेमाल के जरिए बिना सहमति वाले व्यक्तियों के अश्लील वीडियो बनाना और सांझे करना शामिल है और इसका इस्तेमाल व्यक्ति की छवि को खराब करने के लिए किया जाता है।

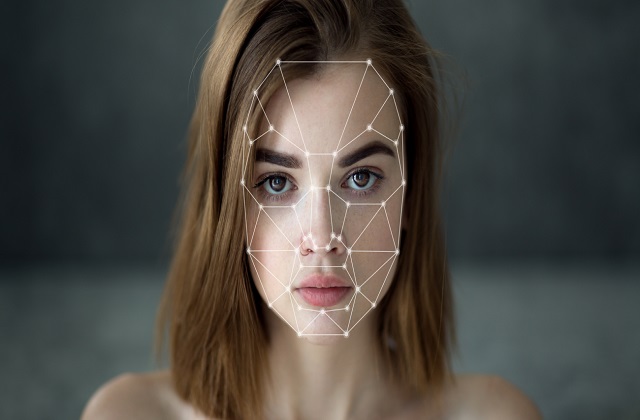

डीपफेक पोर्नोग्राफी, या सरल शब्दों में कहें तो एक प्रकार की कृत्रिम पोर्नोग्राफी है, जिसे पहले से मौजूद तस्वीरों या वीडियो में डीपफेक तकनीक का इस्तेमाल करके बनाया जाता है। आॢटफिशियल इंटैलीजैंस के जरिए आजकल डीपफेक पोर्न बनाया जा रहा है। इसका मतलब है कि ऐसा कोई भी अश्लील वीडियो या चित्र जो हमारा नहीं है मगर उस पर हमारा चेहरा लगा दिया जाता है और ये सब इतना सटीक होता है कि सामान्य इंसान इसे पहचान भी नहीं पाता कि यह नकली है या असली। ‘डीपफेक’ शब्द ‘डीप लॄनग’ और ‘फेक’ का मिश्रण है। इससे वे सब बनाया जा सकता है, जिसे अब ‘सिंथैटिक मीडिया’ कहा जाता है। इसमें किसी व्यक्ति के भाव/कार्यों की नकली तस्वीर या वीडियो क्लिप बनाया जा सकता है। यह न केवल दुनिया को मूर्ख बना सकता है, बल्कि आपकी समझ से भी खिलवाड़ कर सकता है। आॢटफिशियल इंटैलीजैंस के चलते, हर गुजरते दिन के साथ ऐसी डीपफेक तकनीक आसान, सस्ती और अधिक सुलभ होती जा रही है।

कम्प्यूटर की सहायता से बनाई गई नग्न तस्वीरों और वीडियो को डीप न्यूड कहा जाता है। हो यह रहा है कि साइबर अपराधी कृत्रिम बुद्धिमता सॉफ्टवेयर की मदद से वीडियो, ऑडियो और तस्वीरों पर नग्न सामग्री का लेप कर देते हैं। कृत्रिम बुद्धिमता का इस्तेमाल कर किसी व्यक्ति के बोलने के तरीके, सिर तथा चेहरे की गतिविधियों को किसी अन्य व्यक्ति के साथ शामिल कर देने से यह बताना मुश्किल हो जाता है कि यह वीडियो/तस्वीरें सही हैं या गलत। कम्प्यूटर द्वारा तैयार की गईं इन वीडियो/तस्वीरों की सत्यता की जांच गहन विश्लेषण से ही की जा सकती है। साइबर विशेषज्ञ कहते हैं कि डीपफेक वीडियो और फोटो के फेशियल एज, हेयरलाइन्स, आईब्रो, आईग्लास बार्डर देखकर पहचाना जा सकता है। वीडियो प्ले होने पर आंखों और होंठों के मूवमैंट से डीपफेक वीडियो को पहचाना जा सकता है। इस तरीके से बनाए गए वीडियो और फोटो में हाथों और पैरों की लम्बाई एक समान नहीं होती। इस तरह ऐसे वीडियो को पहचाना जा सकता है।

डीपफेक को लेकर आॢटफिशियल इंटैलीजैंस और साइबर दुनिया के दुरुपयोग पर नियंत्रण अत्यंत जरूरी है। साइबर सुरक्षा और सोशल मीडिया के दुरुपयोग का मुद्दा ऐसा है, जिसकी और अनदेखी नहीं की जानी चाहिए। सोशल मीडिया के जरिए गलत सामग्री सांझी करने से लोगों के निजता के अधिकार का हनन होता है, ऐसे में इसके खिलाफ कड़ा नियमन करने की आवश्यकता है। इसके साथ ही डीपफेक पोर्नोग्राफी के कारक के रूप मे आॢटफिशियल इंटैलीजैंस के दुरुपयोग से जुड़े नैतिक पहलू पर बहस होनी चाहिए।-डा. वरिन्द्र भाटिया